OpenAI tra la multa del Garante italiano e il grave down di Chatgpt.

Non una fine d’annoi facile per OpenAI. Nei giorni scorsi la notizia di una multa per 15 milioni di euro da parte dell’‘Autorità Garante per la protezione dei dati personali e, nelle scorse ore, sul sito Down detector diversi utenti segnalano problemi con OpenAI.

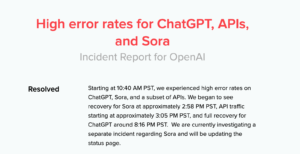

Il sistema sembra riscontrare problemi, con gli utenti che visualizzano un messaggio di “errore del server interno”. Il disservizio è iniziato intorno alle 19:30 di ieri, 26 dicembre, ora italiana. Alle 20:00, OpenAI ha comunicato che ChatGPT, l’API e il generatore di video Sora stanno «affrontando attualmente alti tassi di errore».

Non è ancora chiaro quando il servizio verrà ripristinato. Si consiglia di monitorare i profili social e il sito ufficiale di OpenAI per ulteriori aggiornamenti. L’ultimo episodio simile si è verificato a inizio mese, durante il lancio di Sora per gli abbonati a ChatGPT, quando entrambi gli strumenti sono rimasti offline per alcune ore.

OpenAI e la multa

Ma andiamo con ordine. L’Autorità Garante per la protezione dei dati personali italiana ha imposto a OpenAI una multa di 15 milioni di euro, concludendo un’indagine avviata nel 2023 sulla gestione dei dati personali degli utenti per l’addestramento di ChatGPT.

Una notizia destinata a diventare un vero e proprio caso di scuola e un precedente importante nelle discussioni sulla necessità di un bilanciamento tra l’innovazione tecnologica e rispetto delle normative sulla privacy.

I motivi della sanzione

La sanzione è stata comminata dopo che il Garante ha rilevato diverse violazioni del Regolamento generale sulla protezione dei dati (GDPR) da parte di OpenAI. In particolare:

- Trattamento non autorizzato dei dati personali: OpenAI ha utilizzato dati degli utenti senza una base legale adeguata per addestrare l’algoritmo di ChatGPT, violando i principi di trasparenza e informazione nei confronti degli utenti.

- Mancanza di un filtro sull’età: L’indagine svolta dalle autorità ha evidenziato l’assenza di un sistema efficace per impedire l’accesso a minori di 13 anni, esponendoli potenzialmente a contenuti inappropriati generati dall’AI.

A questi due pilastri principali dell’accusa, si aggiungono problemi legati alle cosiddette “allucinazioni” dell’algoritmo, ovvero risposte errate o inventate generate da ChatGPT sulla base dei dati trattati.

Il Garante ha anche ordinato a OpenAI di avviare una campagna di sensibilizzazione sui media italiani (radio, TV e piattaforme digitali) della durata di sei mesi, per informare il pubblico sulle modalità di utilizzo dei dati personali da parte di ChatGPT.

Una iniziativa che rappresenta una misura innovativa, mai adottata in precedenza dall’Autorità.

Generative AI: perché le aziende dovrebbero conoscerla e implementarla

Come si è arrivati alla sanzione

La disputa tra il Garante e OpenAI è iniziata nel marzo 2023, pochi mesi dopo il rilascio di ChatGPT al pubblico. L’Autorità italiana impose allora un blocco temporaneo al trattamento dei dati personali in Italia, accusando OpenAI di scarsa trasparenza e di non rispettare le regole fondamentali del GDPR, come l’informativa agli utenti e il diritto di opposizione.

La mossa, sorprendente in quel momento, ebbe un riverbero immediato anche in altri paesi, con ripercussioni internazionali: Canada e Spagna decisero di avviare indagini simili, mentre OpenAI sospese il proprio servizio in Italia. Dopo un mese di negoziazioni, ChatGPT fu reso nuovamente disponibile per l’utenza italiana, introducendo nuove funzionalità per migliorare la protezione dei dati, in particolare la modalità “incognito” che permette agli utenti di disattivare la cronologia delle conversazioni.

Ma l’istruttoria del Garante non si era fermata, concentrandosi anche su altri aspetti, tra cui l’uso del web scraping, ovvero la raccolta automatica di dati da internet per addestrare gli algoritmi, senza il consenso degli interessati.

Da parte di OpenAI, queste pratiche sono considerate necessarie per sviluppare l’AI: una giustificazione considerata non sufficiente dal Garante, che puntualizza come l’assenza di una base legale valida costituisca di fatto una violazione del GDPR.

Le contestazioni principali

L’indagine si è articolata su due filoni principali:

- Mancanza di consapevolezza degli utenti: OpenAI non ha informato in modo adeguato gli utenti su come i loro dati venivano utilizzati per l’addestramento del modello linguistico. E proprio questa carenza costituisce la base della richiesta della realizzazione di una campagna informativa, per rendere il pubblico più consapevole e garantire maggiore trasparenza.

- Legalità del web scraping: Una delle questioni centrali è se sia lecito raccogliere dati pubblici online senza chiedere il consenso esplicito dei proprietari. Il Garante ha riconosciuto che OpenAI non aveva una base giuridica chiara per questa pratica al momento dei fatti contestati.

Inoltre, il Garante ha trasferito parte della competenza all’omologa autorità irlandese, dato che OpenAI ha stabilito la propria sede europea in Irlanda. Questo passaggio rientra nel principio comunitario del “one-stop-shop”, previsto dall’articolo 60 del GDPR, che assegna la responsabilità di regolamentazione all’autorità del paese in cui l’azienda ha sede.

La risposta di OpenAI

OpenAI ha definito l’entità della sanzione “non proporzionata” e ha annunciato l’intenzione di presentare ricorso. L’azienda ha sottolineato che la multa equivale a circa venti volte il fatturato generato in Italia durante il periodo considerato. OpenAI ha inoltre evidenziato i progressi compiuti per adeguarsi alle richieste delle autorità, sostenendo di essere un pioniere nella protezione della privacy nell’ambito dell’intelligenza artificiale.

“La decisione del Garante compromette le ambizioni dell’Italia in materia di AI,” ha dichiarato OpenAI, ribadendo tuttavia la volontà di collaborare con le autorità per garantire che l’AI porti benefici alla società nel rispetto dei diritti alla privacy.

Un precedente significativo

La multa di 15 milioni di euro è tra le più alte comminate a un’azienda tecnologica per violazioni del GDPR in relazione all’intelligenza artificiale. Questo riflette la crescente attenzione delle autorità europee verso il rispetto delle normative sulla privacy da parte delle piattaforme AI.

Il Consiglio delle autorità europee per la protezione dei dati ha recentemente pubblicato linee guida per valutare se i modelli di AI rispettano la privacy degli utenti. Secondo queste direttive, è necessario garantire che sia “altamente improbabile identificare direttamente o indirettamente” le persone i cui dati sono stati utilizzati per addestrare gli algoritmi.

Per tutti questi motivi, come accennato in precedenza, il caso rappresenta un precedente importante, mettendo in evidenza le sfide legali e etiche che le aziende tecnologiche devono affrontare nel bilanciare innovazione e conformità normativa. La vicenda di OpenAI sottolinea l’importanza di sviluppare modelli di intelligenza artificiale che rispettino i diritti fondamentali degli utenti, garantendo trasparenza e sicurezza.

Allo stesso tempo, solleva interrogativi sul ruolo delle autorità regolatorie nell’era dell’AI generativa e sulla necessità di creare regole armonizzate a livello globale per gestire l’impatto di queste tecnologie emergenti.

E le prossime decisioni, in particolare quelle delle autorità irlandesi, potrebbero definire ulteriormente il quadro normativo per l’AI in Europa e avere un impatto significativo sull’evoluzione del settore a livello globale.

OpenAI e il caso Chatgpt down

Al momento non si sa con certezza quando il servizio tornerà operativo ma vi consigliamo, se siete utenti d ChatGPT, di tenere d’occhio la pagina di stato ufficiale di OpenAI.